Das Thema Künstliche Intelligenz (KI) ist derzeit in aller Munde – vor allem durch den großen Hype um ChatGPT und Co. Doch bereits seit einigen Jahren wird in den verschiedensten Bereichen KI eingesetzt: von Fahrassistenzsystemen in Autos bis hin zu Alexa & Co im eigenen „Smart Home“. Über den Einsatz von KI, deren Möglichkeiten und Risiken sprechen wir mit Michael Mücke, Geschäftsführer source.kitchen.

Wie beschäftigen Sie sich mit dem Thema KI und wie setzen Sie es in Ihrem Unternehmen um?

Mit source.kitchen bewegen wir uns ebenso wie FIO viel in den Bereichen Immobilien, Finanzdienstleistungen und Schadenmanagement. Wir beschäftigen uns hier tatsächlich schon seit über drei Jahren mit KI und erstellen damit Lösungen, die auf konventionellen Wegen schwer oder gar nicht zu schaffen sind. Hier nutzen wir dies vor allem, um bisherige manuelle Prozesse zu automatisieren.

Können Sie ein konkretes Beispiel für den Einsatz von KI in Ihrer Software nennen?

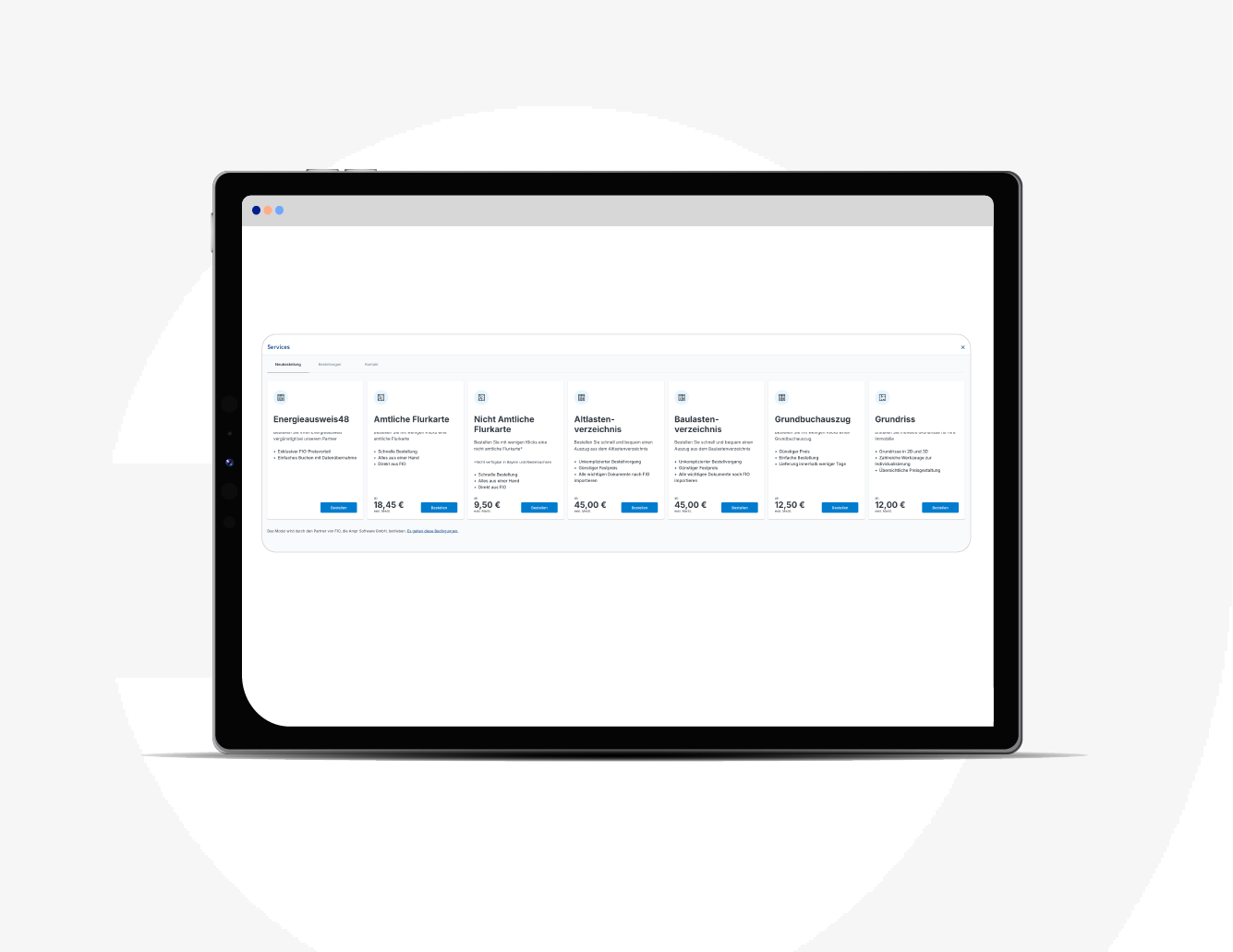

Ein Beispiel ist die KI-gestützte Erfassung und Auswertung von Rechnungen, die zuvor noch oft von Hand abgetippt werden mussten. Im Bereich Immobilienvermarktung haben wir u. a. bildverarbeitende Verfahren entwickelt. So können Immobilienbilder technisch verbessert werden – von der Farbkalibrierung über einen aufgehübschten Himmel bis hin zur Objektivkorrektur der ursprünglichen Aufnahme. Diese Funktionen sind bereits seit einiger Zeit Teil des FIO Webmaklers, bzw. hier werden neue Funktionen sukzessive in zukünftigen Versionen freigeschaltet. Zum Beispiel werden demnächst Fotos direkt beim Einspielen schon klassifiziert, das heißt ein Raum wird beispielsweise als Küche erkannt und so abgelegt. Bei allem ist unser Ziel, dass Makler weniger manuell arbeiten müssen und mehr Zeit für den persönlichen Kontakt, für Besichtigungen und die Pflege ihres Netzwerks haben.

Blicken wir jetzt mal allgemein auf das Thema Künstliche Intelligenz im digitalen Zeitalter. Was bedeutet der Einsatz von KI für unser Leben?

KI ist dabei, sämtliche Lebens- und Arbeitsbereiche zu verändern. In einigen Bereichen wie der Medizin gibt es schon seit Jahren den Einsatz solcher Systeme, z. B. zur Erforschung von Impfstoffen oder der Krebsdiagnostik. Assistenzsysteme im Auto sind ganz normal im Alltag angekommen.

Gerade aber ist ein Goldrausch ausgebrochen, da sogenannte generative KIs wie ChatGPT seit einigen Monaten Aufgaben übernehmen, die bisher Menschen gemacht haben: die Erzeugung von Inhalten, die beinahe kreative Schaffung von Texten oder die komplexe Suche nach Informationen, die immer mehr miteinander verknüpft werden. Dies wird Einfluss auf viele Berufe haben, aber auch neue entstehen lassen.

Die Arbeitsweise dieser KIs beinhaltet aber auch große Risiken in Bereichen des Datenschutzes: Eingespielte Informationen, die aufbereitet werden sollen, bergen das Risiko, dass diese unkontrolliert z. B. in die USA zu den großen Herstellern dieser KIs abfließen können.

Sie sprachen gerade einen der größten Diskussionspunkte – vor allem in Europa – an: den Datenschutz. Wie sehen Sie die aktuelle Lage der KI in Bezug auf die Risiken, Herausforderungen und den Schutz der Daten?

KI und damit einhergehende Risiken sind nicht neu, zudem ist der sensible Umgang mit Daten in Computersystemen schon immer eine notwendige Aufgabe gewesen. Durch Systeme wie ChatGPT und dessen Integration z. B. in die Microsoft-Office-Umgebung wird dies aber nun einer breiten Öffentlichkeit zugänglich gemacht. Und damit steigen natürlich Risiken.

Daher sehe ich hier folgende Bereiche, die wir kritisch betrachten müssen:

1. KI hat Datenhunger.

Die heutigen KI-Systeme haben hunderte von Milliarden Datenpunkte, die miteinander verknüpft wurden. „Large Language Models“, also große Sprachmodelle, sind nicht nur ihren Namen nach „riesig“. Erst dadurch erhalten wir den Vorteil, dass wir eine Kurzzusammenfassung eines Buches via ChatGPT erhalten können oder eine User Journey für ein Produkt schreiben lassen können – allerdings muss dafür auch die KI das Buch kennen oder das Produkt. Und genau hierzu sammelt das LLM immer weiter Daten, die der User im schlimmsten Fall sogar, ohne darüber nachzudenken, mit den eigenen Fragen an solch ein System selbst einspielt.

2. Wir überschätzen KI.

KI kann nicht alles, da diese erstmal in einem definierten Rahmen agiert und dann nur so gut ist wie die enthaltenen Daten. Daher sind Antworten oder Ergebnisse aber ggf. auch nicht immer korrekt. Bei LLMs sprechen wir oft von „Halluzinieren“, also der Erschaffung von Vorstellungen, die es gar nicht gibt. Was aber, wenn solche Systeme zukünftig (allein) über die Kreditvergabe entscheiden? Sind die zugrunde liegenden Daten dafür ausreichend bzw. auch korrekt? Oder die KI, die diese beurteilt?

3. KI ist manipulativ und nicht unparteiisch.

Der vorherige Punkt hat schon gezeigt, dass eine KI erst einmal nicht „unparteiisch“ ist, sondern nur im Rahmen ihrer bekannten Daten agiert. Dort liegt aber auch ein weiteres Risiko: KI-Systeme können genau für rechtlich oder ethisch fragwürdige Zwecke eingesetzt werden, z. B. beim Scoring von Bürgern bzgl. ihrer „Systemtreue“. Die KI ist dabei technisch betrachtet nur ein Werkzeug, das in dem Fall nicht neutral eingesetzt wird. Eine KI ist quasi wie ein „Hammer“, mit dem ich erst einmal optimal einen Nagel in die Wand bekomme. Tatsächlich kann ich aber mit einem Hammer auch etwas zerstören – genau das ist das Grundproblem: Wie setzen wir (als Mensch) Werkzeuge ein?

4. KI ist eine Blackbox.

Eine der großen gesellschaftlichen Fragen: Ist KI gut oder schlecht? Für viele birgt KI Risiken, weil man Entscheidungswege einer KI nicht versteht oder Daten dahinter nicht kennt. Es ist eine Blackbox in der Hand weniger Konzerne. KI ist dann sogar nicht „demokratisch“. Das sind definitiv Fragen bzw. Diskussionen, die man in der Gesellschaft aufnehmen und führen muss. Ich als Techniker kann nur sagen, dass wir sehr genau darauf achten, was wir tun bzw. welche Daten wir in welcher Form durch KI aufnehmen und bearbeiten lassen. Natürlich wollen wir bestimmte Ziele erreichen: unsere Kunden unterstützen, die Effizienz steigern, Hilfestellungen geben und Möglichkeiten schaffen, die bisher vielleicht so nicht zur Verfügung standen – aber bei all dem den Datenschutz und die Ethik im Blick behalten.

5. KI ist (noch) in der Hand einzelner

Die Entwicklung von großen Sprachmodellen (LLMs) beinhaltet hohe Kosten und Aufwände. Bisher war die Entwicklung solcher Systeme in der Hand einzelner Konzerne wie Meta oder Alphabet. Microsoft hat sich zudem in OpenAI (ChatGPT) eingekauft. Gerade durch die Konzentration auf US-amerikanische Anbieter ist hier das Risiko, dass Europa auch technologisch abgehängt wird.

Tatsächlich ist hier sogar der historische Vergleich mit dem amerikanischen Goldrausch zu sehen: Damals haben nicht die Goldgräber, sondern vor allem die Firmen verdient, die Schaufeln zum Graben verkauft haben. Heute ist es etwas komplexer: Die KI selbst ist die Goldgräberschaufel, die Geld (in Form von Daten) verdient, und gleichzeitig (für den Anwender) durchaus auch das Gold-Nugget, was einem einen Vorteil (durch die Ergebnisse, z. B. Prozess-Vereinfachung) gibt. Und für die Firmen natürlich noch mehr der Gold-Esel, der die Aktienwerte der Big KI-Player hochtreibt …

Allerdings: Interessanterweise sehen wir, dass der KI-Goldrausch nicht nur noch mehr entfacht wird, sondern auch Techniken entstehen, mit geringerem Aufwand z. B. eigene LLMs zu entwickeln. Forscherinnen und Forscher tragen hier tatsächlich auch neben der Diskussion zu einer tatsächlichen Demokratisierung bei, da die Technik faktisch für jeden anwendbar und einsetzbar wird und dadurch nicht mehr auf einzelne konzentriert bleibt.

Können Sie ein Fazit aus den genannten Thesen ziehen?

Im Moment glaube ich, dass wir in einem Wechselspiel zwischen „wir unterschätzen“ und „wir überschätzen“ KI liegen. Die Systeme können noch nicht alles, aber sie können immer mehr – und das jeden Tag.

Im Hinblick auf die Zukunft möchte ich ganz gerne ein kleines Zitat mitgeben, was doch sehr nachdenklich macht. Professor Stephen Hawking hat mal gesagt: „Die Entwicklung Künstlicher Intelligenz könnte entweder das Schlimmste oder das Beste sein, was den Menschen passiert ist.“ Ich denke ebenso wie Hawking, dass technologischer Fortschritt viele Möglichkeiten der Weiterentwicklung bietet, aber auch genauso viele Risiken mit sich bringt.

Ich kann nur sagen, dass wir als Unternehmer, Politiker und Gesellschaft, aber auch als Anwender von KI verantwortungsvoll, menschenzentriert und ethisch mit dessen Einsatz umgehen müssen.

Oft wird gesagt, dass viele Arbeitsplätze demnächst durch KI ersetzt werden. Was denken Sie dazu?

Goldman Sachs hat vor Kurzem eine Studie vorgestellt, die besagt, dass 300 Mio. Jobs weltweit wegfallen werden. Bundesarbeitsminister Heil meinte: Wir werden bis 2035 keinen Job mehr haben, der nichts mit KI zu tun hat. Ich glaube, an der Stelle hat er nicht ganz unrecht: Es wird sehr viele Einflüsse geben, aber wir sollten uns auch nicht verrückt machen lassen. In den letzten 100 Jahren haben wir mit der Industrialisierung und der Erfindung des Fließbands etwas Ähnliches erlebt, und auch da waren die Menschen nicht alle plötzlich arbeitslos. Wir sollten eher den „Hammer“ nehmen und damit genügend interessante Anwendungen bauen und die Effizienz steigern.

Wie kann das bei source.kitchen aussehen?

Wir werden KI sowohl für uns in der Entwicklung als auch für unsere Kunden einsetzen, um Analysen zu machen, das Marketing zu stärken und vor allem unsere Software-Produkte weiterzuentwickeln. Konkret kann das im Bereich Design z. B. bedeuten, dass wir Kunden mehrere Varianten zeigen können, weil uns hier KIs unterstützen. Die eingesparte Zeit kann dann in die Entwicklung weiterer Funktionen fließen – also eine Win-Win-Situation. Und bei den ganzen Vorteilen werden wir – nicht nur, weil wir es müssen, sondern weil wir es auch wollen – genau im rechtlichen Rahmen arbeiten, den uns Deutschland bzw. Europa vorgibt. Das beginnt bei einer verantwortungsvollen Arbeitsweise bis hin zum Einsatz deutscher Rechenzentren, die regelmäßig kontrolliert werden.

Denken Sie, dass wir ein globales Kontrollgremium brauchen, um den Einsatz von KI zu überwachen?

Ich kenne diese Fragen und die Diskussionen, die gerade stattfinden. Als Unternehmer sehe ich unsere Aufgabe darin, KI verantwortungsvoll einzusetzen.

Für mich als Teil der Gesellschaft stelle ich mir aber die Frage, wer reguliert was und in welcher Form – sprich wer hat die Kompetenz und das Recht dazu? Wir haben bereits gute Regulatorien, in Form der Gesetzgebung. Und zumindest in den westlichen Ländern haben wir eine gesunde Vorstellung von dem, was tragfähig ist und was nicht.

Michael Mücke, Geschäftsführer source.kitchen

Als Kind der 1980er interessierte sich Michael Mücke schon früh für IT, sodass das Studium der Informatik vorgezeichnet war. Anschließend sammelte er u. a. in der Softwareentwicklung und im Produktmanagement in der Industrie umfangreiche Erfahrungen. Michael Mücke ist seit 10 Jahren bei der FIO, wo er die Innovations- und KI-Abteilung aufbaute und nun seit zwei Jahren als Geschäftsführer das Schwesterunternehmen source.kitchen leitet.